[不止游戏] AI绘画疯狂内卷,究竟是“谁”在画画?

精华修改于2022/09/031617 浏览综合

“自然语言生成图像”,俗称“人工智能绘画(AI绘画)”,又走到了最近的风口浪尖上。

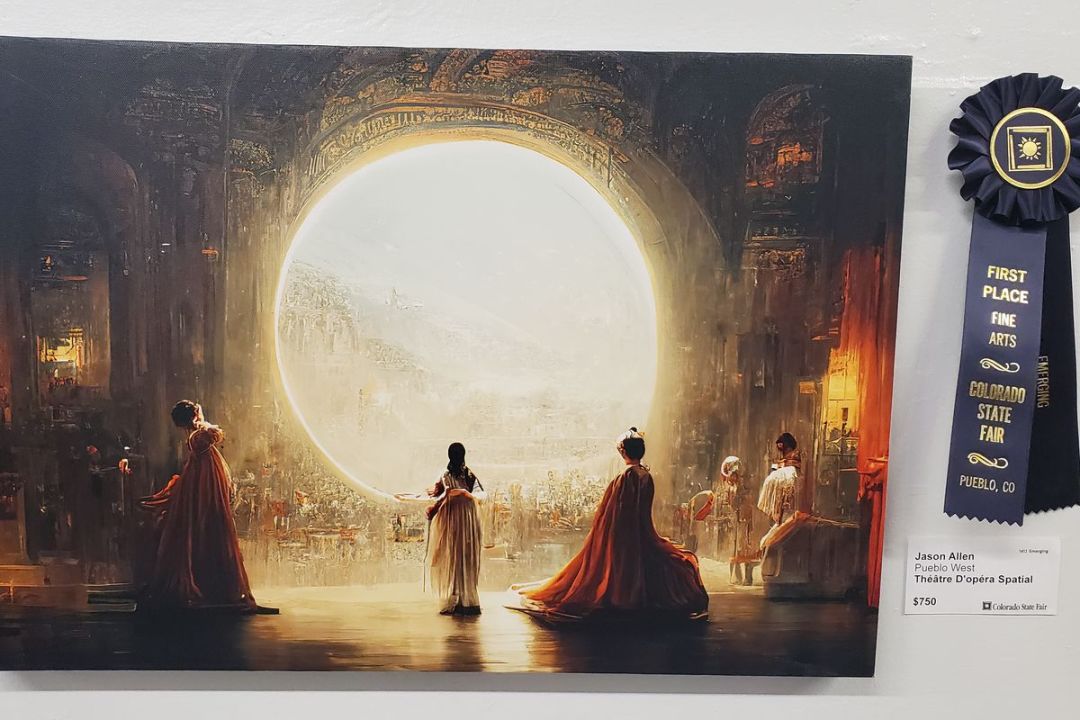

在美国的举行的一场专业的绘画评奖中,有这样一幅画作参赛。身着复古华服的女子在太空中翩翩起舞,画面细节丰富,上色精致。评委看了以后觉得不管是立意还是绘制细节上,都无可挑剔,然后,就宣布这幅画获得本次比赛的第一名。

作者欣喜若狂,在社交网络上表示:这幅作品是使用Midjourney绘制,居然击败了其他的参赛作品,真是太棒啦!

他口中的Midjourney,其实就是目前涌现的AI绘画工具之一。尽管他一再表示自己在这幅画作中投入了无差别的人力劳动,比如选取关键词、调整文本参数、进行后期修改等等,但依然无法获得其他参赛者的认同。其他参赛者认为:你的画并不是你“画”的,你没有资格参与这个比赛。

而虚拟与现实的分割线也在逐渐模糊。在关于重庆山火的报道中,有部分人使用了AI生成的画面来强调火场面对的压力。这些画面在互联网上的传播度极高,如果不强调“非新闻画面”,普通人很难分辨其中真假。

(图片角落写的“非新闻图片”,表示这张图片来自于程序生成)

而创作者面对的压力要更大,会不会哪一天就会出现一个超级人工智能,卷死所有打工人,让打工人无工可打。

转眼之间,我们好像众多真真假假的画面,更多的焦虑和争议包围。这是一个发展过快的技术领域,我们也只能通过如下的切片,试图跟你介绍——它从何处来,它将带我们前往什么地方。

01

笔终于学会自己动

我们之前聊过《过气小游戏,在人工智能领域下岗再就业》,里面有稍微提到现在人工智能的发展状况,其中“自然语言图像生成”是近两年研究的大热门方向。主要原因在于随着神经网络算法的发展,自然语言识别、图片内容识别等等单独的领域,都有了不俗的进展,那么研究者们自然会想着,将这些技能整合起来,提升整个模型的理解能力。

按照清华大学唐杰教授团队COGVIEW基础算法的描述,一个合格的自然语言图像生成算法应当达到以下标准:

1、从像素点中解耦出形状、颜色等一系列特征。也就是说给模型输入一张图片时,它真的能像人一样去“看”到其中的各种物体和特征,而不是一个个无意义的像素点;

2、理解文本,理解文本中描述的画面所指为何;

3、将图像中的物体和特征与单词对齐(包括同义词),意味着模型能够把同一事物的两种模态联系起来;

4、学习到如何将各种物体、特征组合起来,这种生成能力需要更高的认知水平。

目前,以英文为操作语言的“AI绘图”发展极为蓬勃。目前人气比较高的工具就包括——

Disco Diffusion,早在年初就在科技圈和绘画艺术家中掀起热潮。

(Disco Diffusion- Gates of Eden)

Stable Diffusion,根据Disco Diffusion的开源算法改写,同时自己也是开源项目。普通用户注册账号后,可获得200张的免费额度,下载到本地后可自由使用。

(Stable Diffusion:穆夏风格赛博朋克)

Midjourney,刚刚提到的在竞赛中夺魁的人工智能算法,实际上是Disco Diffusion的产品化版本。依托Discord进行测试,由于Discord本身就是一个好用的即时通讯工具,所以频道里聚集了非常多的数字艺术家,讨论氛围也相对好。

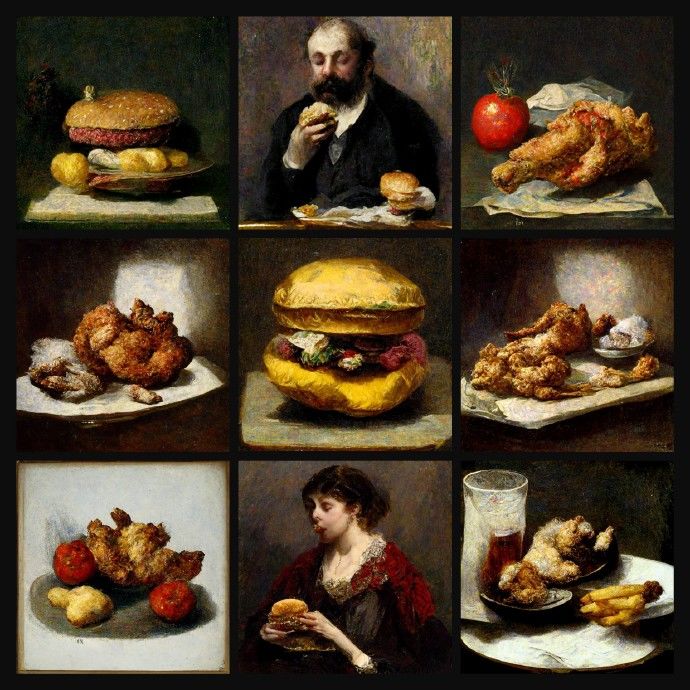

(Midjourney:炸鸡汉堡静物写生)

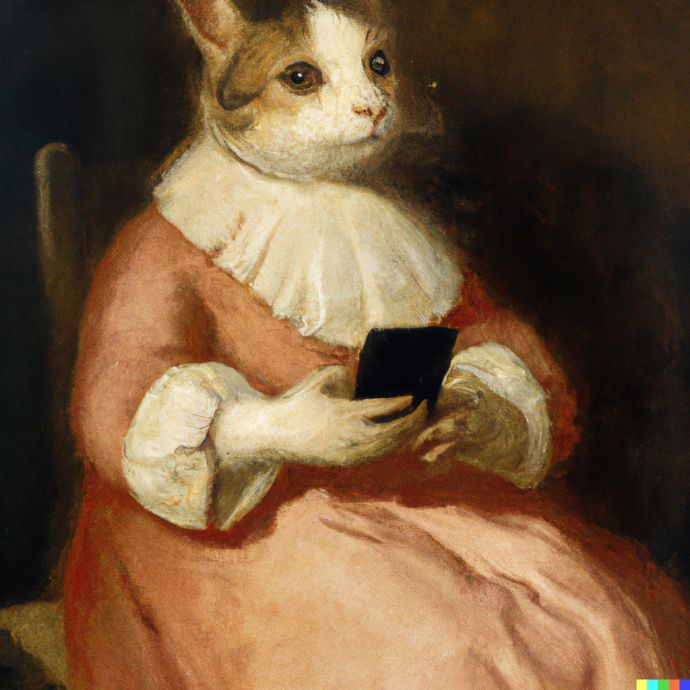

DALL·E 2,号称“乙方设计师的终极形态,**甲方终结者”,由Open AI通用算法迭代而来。Open AI通用算法训练了目前最接近自然语言的GPT-3自然语言模型,换句话说,它训练了目前最能听懂人话,写出跟人类差不多的文本的人工智能神经网络。所以,由Open AI开发的DALL·E 2模型,可以说是最能听懂人话的模型。

(DALL·E 2:用手机的猫)

此外,还有支持原生中文的Tiamat,微软开发的NUWA(女娲),谷歌开发的Imagen,Parti两个互相卷的算法,Meta开发的Make-A-Scene等等。整个领域在以非常惊人的速度进化、迭代。

(Tiamat作品)

如果说人类的认识是对数式、渐进的认识过程,以算法和人工智能为代表的硅基智能,则呈现出指数式的增长。让笔自己动已经不再是梦想,只要你能清楚描述自己要什么画面,算法就会将异彩纷呈的碎片呈现在你眼前。

02

画师们急了,但AI也并非无所不能

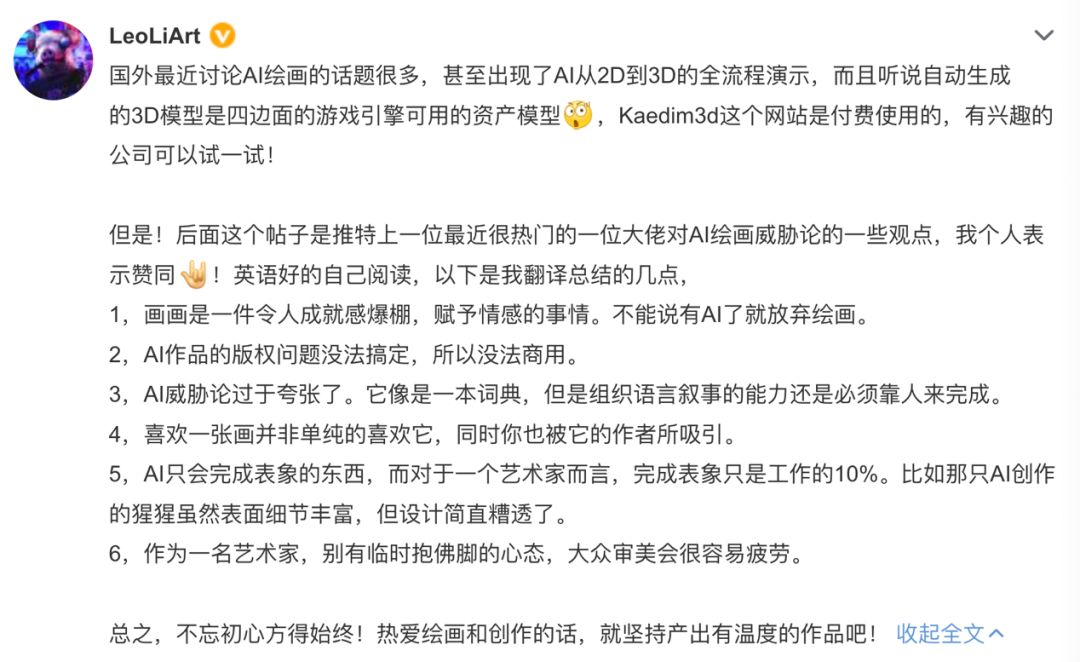

但这种无视创作意图,近乎流水线生产的“量产数字绘画”,的确令人恐惧。

有人恐惧于,可能造成的技术滥用,以及背后的一部分道德问题,比如现实和虚拟的界限进一步混淆。也有人有更实际的担心:我作为一个美术,以后画都给AI画了,那我还做啥?

在游戏行业,这个担心尤其现实。对于独立开发者来说,这可以是非常低成本尝试美术风格的方案,并且已经有人这么做了。但对于画手来说,将自己的绘画扔到算法里面,作为训练素材,然后得到一个“似己而非己”的四不像,甚至对方画得有可能比你还好,无疑会撼动自己对于“存在”的定义——原来“我”并不特殊。

最近,日本一家公司推出的绘画AI“mimic”的β版上线。该网站主打学习功能,用户上传不低于15张图,AI就能学习其画风自动生成新的图片。

而日本画师就在推特上明确表示:禁止任何人将自己的作品上传到该网站,作为AI学习和模仿的材料。一个画师的画风需要长时间的积累,同时也是一个画师跟其他画师区别的关键。而只需要15张图就可以模仿画风的AI,则会“偷”走画师们最珍贵的东西。

线索纷繁复杂,我们不知道自己打开的是新时代的大门,还是潘多拉的盒子。

但AI也并非无所不能。

首先第一个问题,目前的自然语言生成图像,所使用的自然语言是有限制的。必须使用比较精确的风格描述、作者类比,以及内容描述,才能获得一张完整的图像。打个比方,你可以说自己要一张“日本浮世绘风格,窗户,窗前有张桌子,桌子上有堆静物水果”的画面,但你不能说“很忧伤,我想要一张呈现忧伤氛围的图”。这是目前的AI无法理解的内容。

另外一个问题,则是画面的空间感呈现上。大部分AI无法画镜子、水面倒影或者是折射、漫反射,透明杯子后面折射的物体等等,光线复杂的环境。而AI绘画的基础逻辑是基于统计学的,它不懂光学。这是一个比较底层的问题,目前也还没有太好的解决方案。

人的浪漫自由,和算法的冷酷精确,在AI绘画的话题上,形成了鲜明的对比。而如果将所有的浪漫自由统统捕获,我们又会迎来怎样的未来呢?

原神3.0的主线剧情,千朵玫瑰带来的黎明,对须弥的虚空技术进行了简单介绍。简单来说,须弥的虚空系统,可以理解成某种大型的分布式计算装置。这个装置白天给人灌输知识,晚上则占用须弥人的“冗余算力”(也就是梦境),去“见证神明的诞生”。结果就是:须弥人丧失了做梦的权利。

我一直认为梦是人类生活非常重要的组成部分。梦,以及其连接的无意识或者感受的海洋,对个体来说,是可以释放日常生活的焦虑,或者窥见生活的真实。但如今有算法替人绘梦,梦境有了具体的形态,那我们,还能绘制什么呢?

03

所以,究竟是谁在画画

所以问题来了,这么好用的工具,融合了无数人的智慧结晶,最后究竟是谁在画画?是提供AI训练材料的无数画家,是编写生成算法的工程师,还是在输入生成文本、选择最终呈现的的用户?

这是一个非常有趣的问题。最后,究竟,是谁,在画画?

如果你在文本生成图像软件里面,写一个“林中、月夜、雪”的关键词,拿到的内容也不算差。几乎所有画面的左上角或者右上角,都会有一个圆圆的白色物体。你知道那“是”月亮。但你也知道,在生成的时候,它并没有更多的想法,它只是呈现,只是在采集了成千上万的类似主题图片之后,发现:此处应有白色椭圆。

所以它就在里面加上了。

(Stable Diffusion:川瀨巴水的意大利之旅)

肉体苦弱,机械飞升。就提炼现实方面,算法要比人更强悍。单线程的脑子,怎么可能跟多线程的硅基主板相提并论呢?但就有生之年的情况来说,我们终究无法成为肉体跟义肢混合的新人类。只要还活着,就会被困在名为身体的牢狱里,只能做到那些人类才能做到的事情。

所以让我们回到创作的起点吧:想要诉说,想要让更多人知道自己某时某刻的想法、感受,一闪而过的念头。去做一些只有人类才能完成的事情,去讲述你自己的故事吧。

非常感谢木遥在微博上的科普,李rumor的相关介绍,Simon-阿文的图片示范。

同样感谢画手朋友们孜孜不倦的自我表达,你们的作品是我重要的精神补给。

文 | 星咏